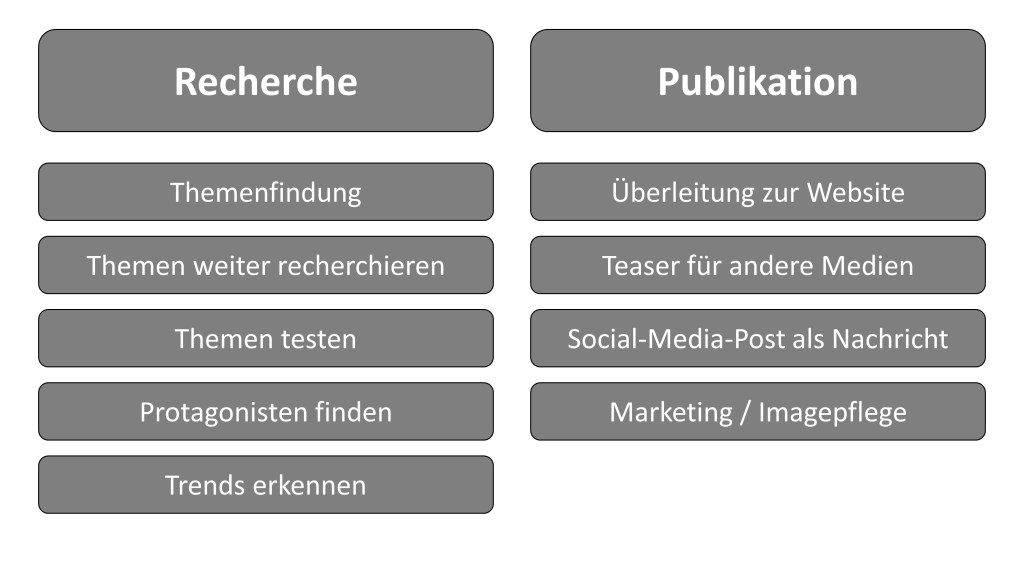

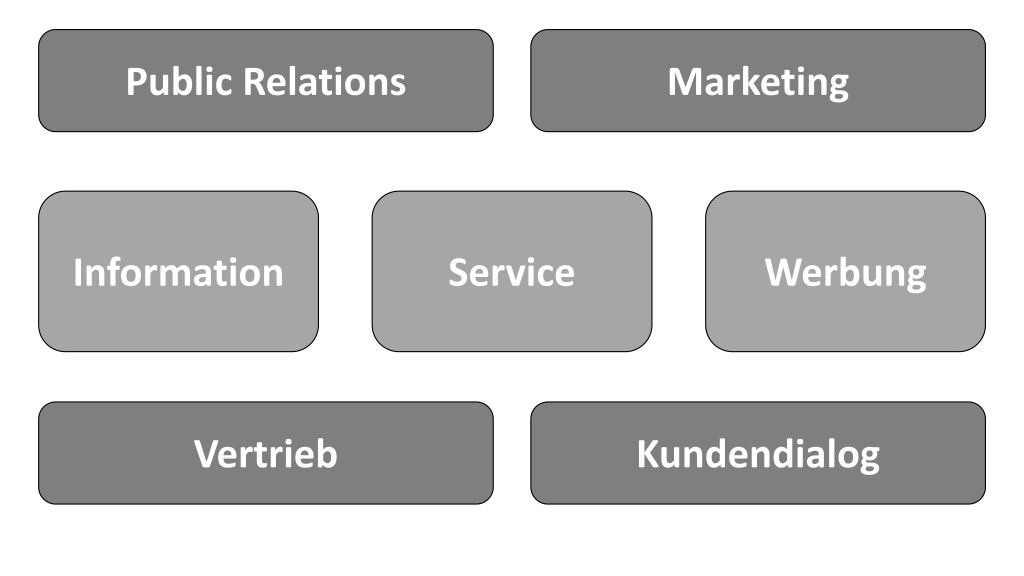

Über das Radio der Zukunft haben wir in den vergangenen Wochen viel diskutiert. In einem Blog-Beitrag habe ich geschildert, wie Künstliche Intelligenz Formatradios verändern wird. Aber wo und wie kann KI sinnvoll eingesetzt werden, um journalistische Audio-Inhalte automatisiert zu generieren?

1. KI hilft bei der Skalierung von Audio-Inhalten

Künstliche Intelligenz ist im Journalismus bei der Inhalte-Generierung immer dann hilfreich und sinnvoll, wenn es um Automatisierung geht, in der Produktion von Inhalten also um Skalierung. Im Audio-Bereich gibt es mehrere Anwendungsbereiche:

- Jemand moderiert eine Sendung, die (wie bei Radio Galaxy) auf mehreren regionalen Sendern ausgespielt wird. Beispielsweise das Wetter soll regionalisiert werden. Hier wäre es nützlich, das Wetter via geklonter KI-Voice einzubinden, damit sich die Moderatorin oder der Moderator auf die eigentliche Moderation der Sendung fokussieren kann und nicht in einem weiteren Studio wie am Fließband das aktuelle Wetter für mehrere Regionen einsprechen muss. Wenn es diese Aufspaltung in verschiedene Sendegebiete nicht gibt, ist das Wetter genauso schnell selbst eingesprochen. KI-News sind durchgefallen, findet für solche Fälle zum Beispiel auch Yves Simon in seinem Gastbeitrag über die Radionachrichten der Zukunft.

- Ein Zeitungsverlag mit mehreren Außenredaktionen möchte die bereits recherchierten Inhalte auch für Podcasts nutzen. Von Multimodalität spricht man, wenn sich die Grenzen zwischen Text und Audio (wie hier), aber auch Video und Data auflösen. Für den geschilderten Fall bietet sich ein Podcast-Generator (wie ich ihn in einem Beitrag auf der Website von THINKING LABS beschrieben habe) an, wenn jede Region einen eigenen Podcast erhalten soll. Ein einziger Podcast, der die Inhalte aller Regionen zusammenfasst, wäre inklusive Qualitätssicherung sicherlich genauso schnell von einem menschlichen Host vorgelesen (ggf. mit etwas KI-Hilfe bei der Umformulierung der Inhalte). Hier liegt der Vorteil der KI wieder darin, dass es um mehrere Podcasts geht, als zum Beispiele Hyperlokalität möglich wird. Die Kosten für die Token zur Generierung sind derzeit noch das Ausschlusskriterium, warum nicht jeder User übrigens seinen komplett personalisierten Podcast erhalten kann. Technisch wäre dies natürlich auch heute schon möglich.

- Wenn sich die Zielgruppen eines Medienunternehmens massiv unterscheiden, kann KI helfen, die Inhalte unterschiedlich aufzubereiten: einmal für Fachleute, einmal für Laien, einmal für Senioren, einmal für Kinder. Möglich ist es, dass KI auch sprachliche Unterschiede macht: für Senioren werden Anglizismen bewusst weggelassen, für Jugendliche (dosiert und nicht übertrieben) Jugendsprache eingesetzt. Denn Sprache ist etwas, das sehr stark verbinden oder ausgrenzen kann. Bei meinen Erstsemestern an der Technischen Hochschule Nürnberg Georg Simon Ohm mache ich beispielsweise immer das Experiment und frage, was ein Drahtesel ist. Nur wenige wissen dies heute noch. Und doch findet sich in Tageszeitungen immer wieder eine Überschrift mit dem (aus Sicht meiner Erstsemester) antiquierten Wort. Dafür würden Senioren eher stutzen, wenn im Audio Wörter wie „random“, „cool“ etc. eingestreut wären.

2. KI hilft dann, wenn der Mensch vorher das Format entwickelt hat

Notebook LM von Google und ähnliche Tools schaffen es ganz gut, aus Text (wie ganzen Büchern oder wissenschaftlichen Aufsätzen) ein Gespräch zu simulieren. An die Qualität eines Radiobeitrags kommt dies allerdings bislang noch selten heran. Einen Podcast automatisiert von der KI generieren zu lassen, bedarf daher noch massiver Vorplanung. Wenn die Formatentwicklung ernst genommen wird, steigert dies die Qualität massiv. Und wirkt gemeinsam mit den anderen Produkten der Medienmarke nicht als Fremdkörper, sondern passt sich hier optimal ein.

- Beim Podcast geht es um mehr als Text-to-speech. Es geht darum, dass zum Beispiel Texte von einer Nachrichten-Website von einem KI-Nachrichten-Duo (unterhaltsam) vorgetragen werden. Schließlich wirkt das Vorlesen von Nachrichten von nur einer (KI-)Stimme relativ schnell ermüdend für den User. Auch gilt es, Schriftdeutsch in gesprochenes Deutsch umzuwandeln (und ggf. auch die Sprache etwas zu verjüngen, um andere Zielgruppen zu erreichen, siehe oben). Hier kann man natürlich frei wählen, ob man eine geklonte Voice nimmt (beispielsweise eines bekannten Redakteurs oder Moderators) oder eine künstlich generierte Stimme. Eleven Labs gilt hier weiterhin als Premiumanbieter für KI-Stimmen. Wenn die Audios aber skaliert werden sollen, gilt es neben der Qualität auch auf den Preis beim Anbieter zu achten.

- Aus der Chatbot-Forschung (noch vor dem KI-Boom) haben wir zahlreiche Erkenntnisse, welche Persönlichkeiten von Chatbots (übertragbar heute auf Avatare und KI-Stimmen) bei Userinnen und Usern wie ankommen. Diese sollten auch in die Formatentwicklung miteinfließen. Auch stellt sich die Frage, ob eine KI-Stimme menschliche Züge annehmen soll (vielleicht etwas überzeichnet sogar) oder bewusst nicht.

- Rubriken (wie „Sport“, „Blaulicht“ etc.) können vorher definiert werden. Inhalte werden dann automatisch gruppiert und diesen Rubriken zugeordnet. Ein Jingle vorher bietet den Hörerinnen und Hörern Orientierung. Auch ist es möglich, die Inhalte hierarchisch nach dem Nachrichtenwert sortieren zu lassen – und als letzte Meldung eine möglichst positive Nachricht auszuspielen.

- Wenn eine Reporterin oder ein Reporter für die News-Website oder ein Printprodukt vor Ort war, kann es von den Protagonisten O-Töne mitbringen. Auch diese können (automatisiert) in den Audio-Beitrag eingebunden werden. Am Ende klingt es wie in einem professionellen Radio-Feature, denn die O-Töne werden immer an den passenden Stellen eingebaut. Wie dies funktioniert? Aus dem O-Ton (zum Beispiel vom Bürgermeister) macht man Speech-to-Text. Dazu packt man den Text von der News-Website. Das Large Language Model (LLM) wiederum gestaltet das Gesamtpaket Audio-affin um mit der Vorgabe, die O-Töne dürfen geschnitten (gekürzt), aber nicht verändert werden. Beim nächsten Schritt (text-to-speech) wird der O-Ton nicht von einer KI-Stimme noch einmal vertont, sondern wieder im Original (hier vom Bürgermeister) eingespielt. Nur das Moderatoren-Duo sind dann KI-Stimmen.

Dies sind nur einige Beispiele dafür, wie durch eine professionelle Formatentwicklung ein News-Podcast noch einmal deutlich an Qualität und Nutzerakzeptanz zulegen kann.

3. KI als Handwerkszeug

Künstliche Intelligenz kommt vor allem auch als Handwerkszeug ins Spiel. „Äh“ und „Ähm“ werden automatisiert aus Beiträgen geschnitten, Interviews automatisiert gekürzt und Social-Media-Teaser erstellt (wie dies zum Beispiel beim Tool Riverside schon standardmäßig der Fall ist). KI hilft beim Produktions-Workflow und schafft für Redakteurinnen und Redakteure die zeitlichen Freiräume, sich wieder verstärkt um die (hochwertigen) Inhalte zu kümmern.

Bei Podcasts übernimmt die KI außerdem die Erstellung von Schlagworten und der Shownotes. Das heißt, auch hier kümmert sie sich um lästige Pflichtaufgaben.

4. KI ist schneller als der Mensch

Im Sport geht nichts über live. Eine Live-Schalte aus dem Fußball- oder Eishockeystadion macht Radio, das häufig als das „schnellste Medium“ beschrieben worden ist, unverzichtbar. Durch Livestreaming auch via Instagram und LinkedIn gibt es heute für live zwar noch weitere Möglichkeiten. Für diese Art der Liveberichterstattung braucht es aber auch dort (noch) Journalistinnen und Journalisten.

Der Mehrwert der KI liegt vor allem in unerwarteten Ereignissen, die über Dritte (wie die Polizei) zum Radiosender kommen. Das beste Beispiel: die Geisterfahrer-Meldung im Radio. Wenn diese KI-generiert ausgespielt wird, erreicht sie die Autofahrerinnen und -fahrer mindestens 30, vielleicht sogar 60 Sekunden schneller, als wenn der Moderator mitten in den Song hinein ein Break macht. Dies kann in solchen Situationen entscheidend sein. Auch nachts, wenn kein Moderator mehr im Sender ist und der Betrieb automatisch läuft, informiert die KI über Verkehrsmeldungen (wie bereits jetzt schon zum Beispiel im Bayerischen Rundfunk). Ein echter Mehrwert durch KI.

Transparenzhinweis: Der Autor ist Professor an der TH Nürnberg und auch für das KI-Unternehmen THINKING LABS aus Neustadt an der Weinstraße tätig, die einen Podcast-Generator entwickelt haben.